Теория информации

Claude Shannon дал такое определение информации:

Случайный источник

Концепция неограниченного источника "экспериментов"; тоже вероятностное пространство.

Энтропия Шеннона

Единственная формула для количества информации.

Пусть

(

Рассмотрим частный случай для

Определим для него

Тогда свойства энтропии Шеннона:

- монотонность энтропии - Рассмотрим вер. пр-во:

Тогда число элементарных исходов

Пусть у случайного источника "сломался дисплей" и он выдаёт только первый компонент пары. Тогда этот "сломанный" случайный источник эквивалентен случайному источнику с распределением вероятности. Количество информации -

Теперь "открываем" вторую компоненту. Тогда количество информации полученное на втором шаге:

Теперь проведём эксперимент "разом", получивинформации Это называется аддитивностью энтропии. - Для фиксированного

, - непрерывная как функция

Теорема

Лемма 1

Доказательство

Зафиксируем константу

Лемма 2

Лемма 3

Рассмотрим

Докажем Теорему для

Что если перенести количество информации со случайного источника на что-то детерминированное?

- Это не корректный перенос

- Если перенести на данные похожие на случайные, будет что-то

содержательное

Пусть

Проводим

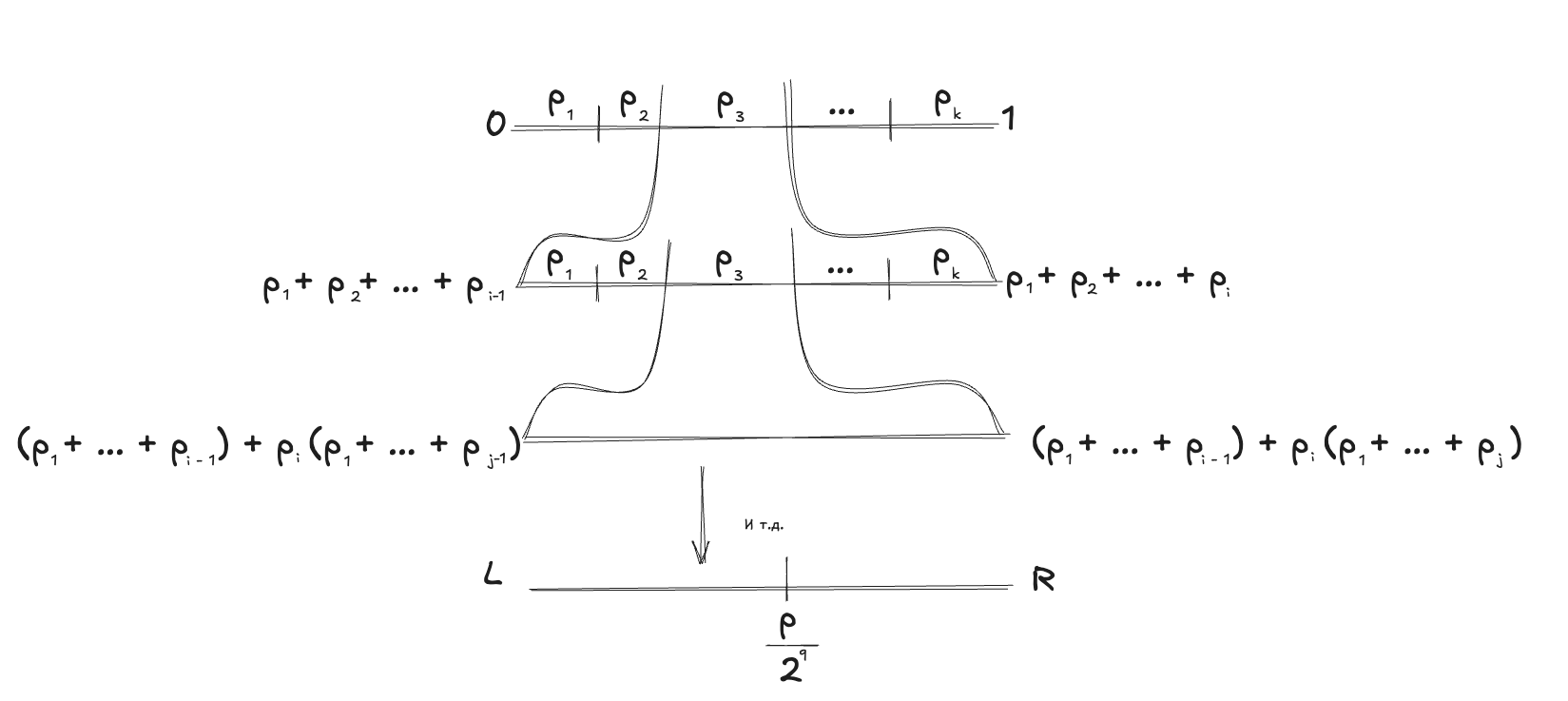

Вспомним арифметическое кодирование:

Длина кода который получается для строки

Нижняя оценка для сортировки